Introducción

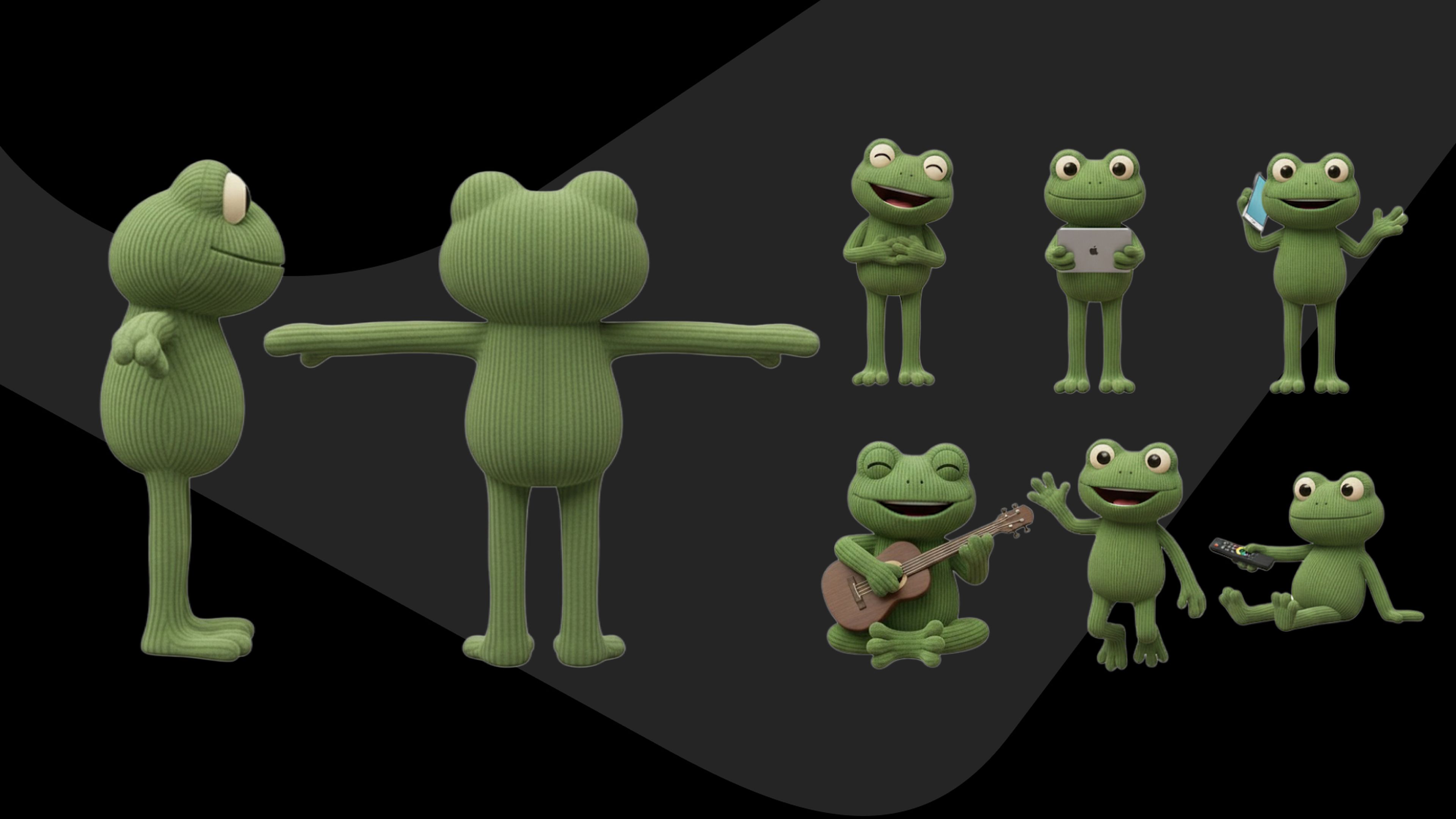

Durante los últimos meses, hemos abordado diversos proyectos de video de IA, como activos sociales para Old Captain Rum, videos interactivos para Rituals e intro para la plataforma de IA Lurni. Pero recientemente, nos enfrentamos a nuestro desafío más ambicioso hasta ahora: crear una campaña completa para Overstappen.nl, incluyendo un comercial de televisión, elementos digitales estáticos y activos sociales. Completamente creados con IA.

El comercial se emitió en la televisión holandesa este mes, y ahora queremos llevarte detrás de cámaras. Esta es la historia completa de nuestro proceso, desde el concepto inicial del personaje hasta la emisión final, incluyendo las herramientas que usamos, los obstáculos que superamos y las lecciones cruciales que aprendimos.